La sécurité cloud occupe une place croissante dans les agendas IT. NIS 2 entre en application, ISO 27001 reste sur les feuilles de route, et les organisations qui ont migré sur Azure ou AWS ces dernières années arrivent au moment où la dette de configuration accumulée demande à être adressée.

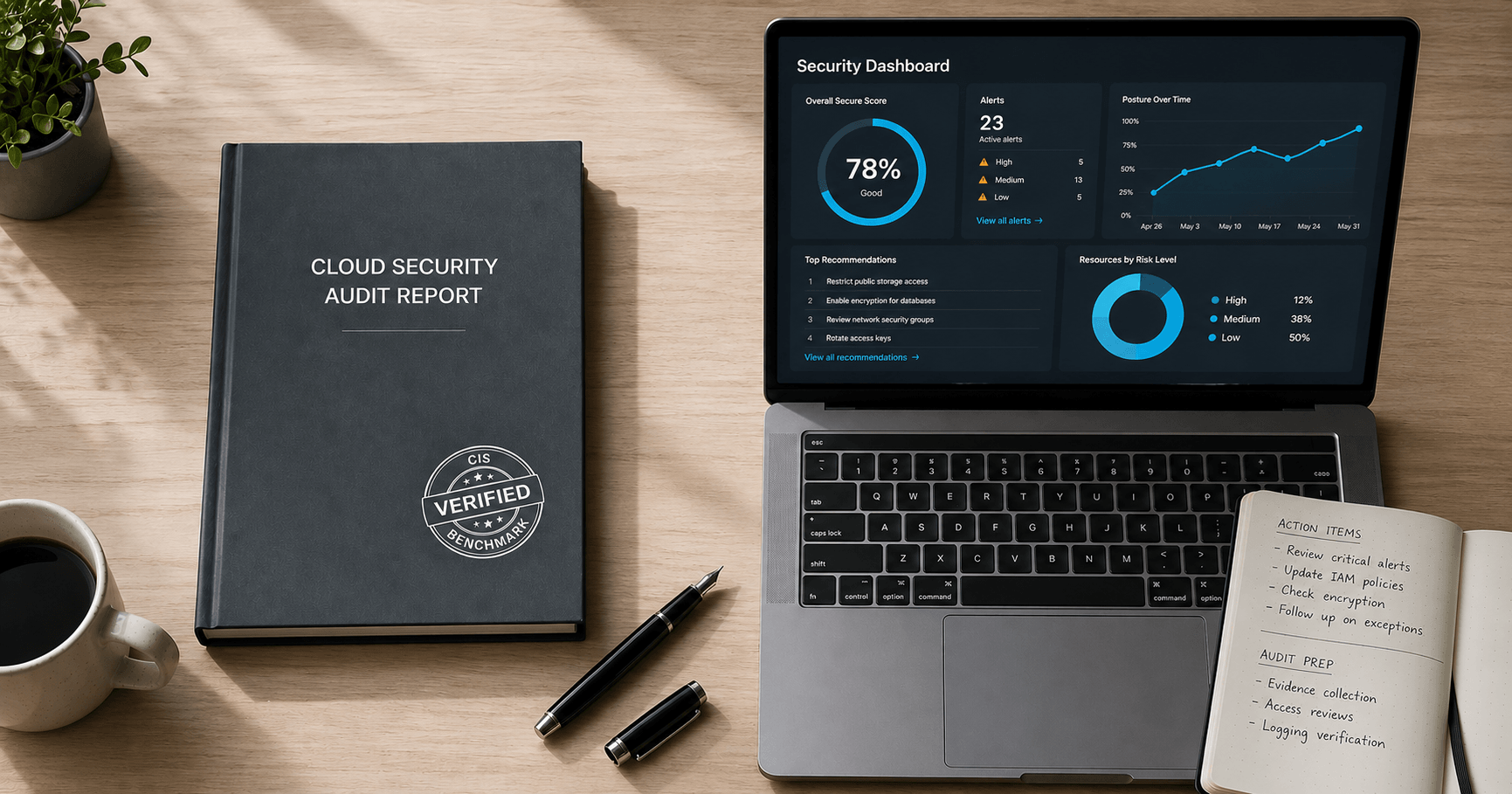

Dans ce contexte, deux familles d’outils dominent les discussions : d’un côté les solutions de monitoring continu intégrées aux clouds (Microsoft Defender for Cloud, AWS Security Hub, leurs équivalents tiers comme Wiz ou Prisma Cloud), de l’autre les démarches d’audit ponctuel basées sur des référentiels reconnus, principalement le CIS Benchmark.

Ces deux approches sont régulièrement confondues, ou présentées comme alternatives. Or elles répondent à des questions différentes, et choisir l’une plutôt que l’autre tend, dans la plupart des contextes, à laisser un angle mort coûteux. Voici ce que fait chacune, et pourquoi les articuler vaut souvent mieux que de les opposer.

Le monitoring continu : surveiller les dérives en temps réel

Les solutions de monitoring continu de la posture de sécurité cloud — appelées CSPM dans le jargon (Cloud Security Posture Management) — observent en permanence la configuration des ressources cloud d’une organisation. Defender for Cloud côté Microsoft Azure, Security Hub côté AWS, Security Command Center côté Google Cloud sont les implémentations natives les plus répandues. Des solutions tierces comme Wiz, Prisma Cloud ou Lacework couvrent les mêmes besoins de manière unifiée multi-cloud.

Ces outils répondent à une question opérationnelle : qu’est-ce qui ne va pas en ce moment dans mon environnement ?

Concrètement, ils alertent en temps réel quand une ressource est créée avec une configuration risquée — un bucket S3 ouvert au public, une base de données sans chiffrement, un Network Security Group laissant passer le RDP depuis Internet. Ils proposent des recommandations actionnables, souvent assorties d’une procédure de remédiation guidée. Et ils fournissent un score de posture qui évolue au fil de l’eau.

Leurs forces : l’intégration native dans les workflows ops, la granularité des alertes, la couverture 24/7 sans intervention humaine. Pour une équipe sécurité opérationnelle, ce sont des outils précieux et souvent indispensables.

Leurs limites tiennent à leur nature même. Ils mesurent l’application des recommandations propres au fournisseur cloud, pas la conformité à un référentiel reconnu de l’industrie. Leur format de restitution est conçu pour des praticiens, pas pour un comité d’audit ou un certificateur externe. Et leur vue est par construction liée à un fournisseur — un environnement multi-cloud demandera plusieurs outils ou un agrégateur tiers.

L’audit ponctuel CIS : photographier la posture à un instant donné

L’audit basé sur le référentiel CIS Benchmark suit une logique différente. Le Center for Internet Security publie depuis plus de vingt ans des référentiels de durcissement pour systèmes d’exploitation, bases de données et plateformes cloud. Les benchmarks Azure et AWS couvrent aujourd’hui plus de 160 contrôles techniques, organisés par domaine — identité, base de données, stockage, journalisation, réseau, etc.

Un audit CIS répond à une question de gouvernance : quel est mon niveau de conformité, à une date donnée, dans un format défendable face à un auditeur externe ?

L’exercice est ponctuel par nature. Il consiste à confronter, à un instant T, l’ensemble des contrôles du référentiel à la configuration effective de l’environnement cloud. Le livrable est structuré, daté, archivable, et chaque finding est rattaché à un identifiant CIS stable, lui-même cartographié sur les principaux frameworks de conformité — ISO 27001, NIS 2, SOC 2, PCI DSS.

Ses forces : la couverture intégrale d’un référentiel publique et reconnu, la comparabilité entre deux passes successives, et la production de pièces utilisables en démarche de certification. Un audit CIS bien conduit est l’un des outils les plus efficaces pour préparer un passage ISO 27001 ou pour répondre à une exigence de due diligence.

Ses limites sont l’image inversée du monitoring continu. Une photographie prise en janvier ne dit rien de l’état du système en mars. Entre deux audits, les dérives s’accumulent sans être détectées par l’exercice lui-même.

La confusion qui coûte cher : trois cas concrets

Trois situations reviennent régulièrement en mission auprès d’organisations mid-market. Elles illustrent le coût pratique de la confusion entre les deux approches.

« Notre Defender for Cloud est à 78%, on est conforme. »

Le Secure Score de Defender for Cloud, et son équivalent AWS Security Hub, ne sont pas des scores de conformité réglementaire. Ce sont des indicateurs de l’application des recommandations propres au fournisseur, pondérés selon des règles internes. Un score à 78% peut très bien correspondre à une couverture CIS de 65% ou de 90% selon les contrôles considérés. Présenter ce chiffre en comité de direction comme une mesure de conformité crée une assurance qui ne tient pas devant un auditeur externe.

« On a un audit CIS annuel, on est bon. »

Sans monitoring continu, la posture mesurée en janvier dérive mécaniquement au fil des semaines. Les nouveaux services déployés ne respectent pas toujours les standards, les exceptions accordées en urgence ne sont pas suivies, les rotations de clés sont oubliées. Une organisation qui était à 92% de conformité après son audit annuel peut se retrouver à 76% six mois plus tard sans que personne ne le voie. Au moment du prochain audit, la régression est constatée mais la cause précise est perdue.

« On a les deux mais on ne sait pas quoi faire des résultats. »

Quand les deux outils fonctionnent en parallèle sans articulation, les équipes se noient. Les findings du monitoring ne sont pas qualifiés à l’aune du référentiel CIS, donc les corrections opérationnelles ne se traduisent pas mécaniquement en gains à l’audit suivant. Inversement, les remédiations issues de l’audit ne sont pas tracées dans le monitoring, qui continue à alerter sur des points déjà traités. Le résultat tend à être un sentiment de débordement et une absence de visibilité sur la trajectoire d’amélioration.

Comment articuler les deux approches

Une fois la complémentarité posée, l’articulation pratique tient sur trois principes.

L’audit ponctuel sert de baseline périodique. Il fournit la photographie complète à un instant donné, le livrable certifiable pour les exigences de conformité, et la mesure d’évolution entre deux passes. Sa fréquence dépend du contexte : annuelle pour la plupart des organisations, semestrielle ou trimestrielle pour celles soumises à des exigences plus strictes.

Le monitoring continu prend le relais entre les audits. Il détecte les dérives au fil de l’eau, intègre les corrections dans les workflows ops, et alimente le tableau de bord de sécurité quotidien des équipes. Sa valeur principale est dans la réactivité.

L’articulation entre les deux se fait par la traçabilité. Les findings critiques du monitoring sont rapportés dans le registre de remédiation issu de l’audit. Les corrections appliquées en mode opérationnel sont documentées de manière à pouvoir être présentées comme preuves lors de l’audit suivant. Cette traçabilité tend à se faire mieux avec un cadre formel — registre des exceptions, revue mensuelle des écarts, mesure trimestrielle de progression.

Un cadre d’usage type pour une organisation mid-market combine un audit CIS annuel ou semestriel, un monitoring continu via la solution native du fournisseur cloud, et une revue mensuelle de gouvernance qui rapproche les deux sources.

En synthèse

Le monitoring continu et l’audit ponctuel CIS ne sont pas concurrents. Ils répondent à deux questions distinctes : l’une opérationnelle, l’autre de gouvernance. Choisir un seul des deux outils tend, dans la plupart des contextes, à laisser un angle mort — soit la photographie certifiable, soit la couverture du temps réel.

La logique de complémentarité décrite ici est au cœur de la méthodologie que YopoConsulting applique sur ses missions d’audit cloud auprès d’organisations belges et françaises.